使用 Apache Kafka 进行数据流

大家好,今天咱们聊聊面试中高频出现的 Apache Kafka 及其在数据流处理中的应用。理解 Kafka 的核心原理和场景,绝对是后端和中间件方向的加分项!

2025年Java面试宝典重磅分享! 涵盖最新Kafka、分布式、微服务等核心考点,助你高效备战: 点击获取:2025年Java面试宝典 (提取码: 9b3g)

Kafka 是什么?为什么需要它?

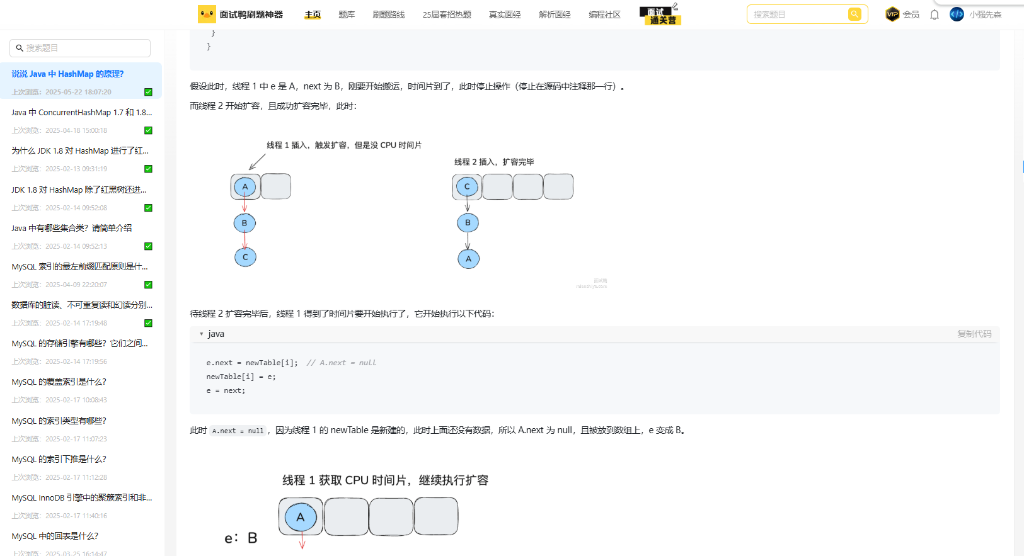

想象一下这个场景:多个系统(订单、库存、物流)需要实时获取用户下单事件。传统点对点调用不仅耦合高,一个系统挂了还会影响整体。Apache Kafka 作为分布式数据流平台,核心就是解决这类问题:

- 高吞吐、低延迟:每秒处理百万级消息,满足实时数据流需求。

- 持久化与可靠性:消息持久化到磁盘,支持多副本保证数据流不丢失。

- 解耦生产者与消费者:系统间通过 Topic 通信,互不干扰。

- 水平扩展:通过增加 Broker 轻松应对数据流增长。

(Kafka 核心组件:Producer, Broker, Consumer, Topic, Partition)

(Kafka 核心组件:Producer, Broker, Consumer, Topic, Partition)

Kafka 核心概念拆解

Topic 与 Partition:数据流的组织方式

- Topic:逻辑上的数据流分类,比如

order_events。 - Partition:Topic 的物理分片。这是 Kafka 实现高并发和水平扩展的关键!数据流被分割到多个 Partition 并行处理。

- 面试点:为什么需要 Partition?提高并行度、负载均衡、支持海量数据流。

Producer:数据流的源头

- 负责将消息发布到指定的 Topic Partition。

- 关键策略:

- 分区策略:轮询、Key哈希(保证相同Key的消息进同一Partition,维护顺序性)、自定义。

- ACK机制:

acks=0(最快)、acks=1(Leader写成功)、acks=all(ISR副本同步成功)。可靠性要求高的数据流选all。

- 面试点:如何保证消息顺序?同一个 Partition 内消息有序,需确保业务上有序的消息使用相同的 Key。

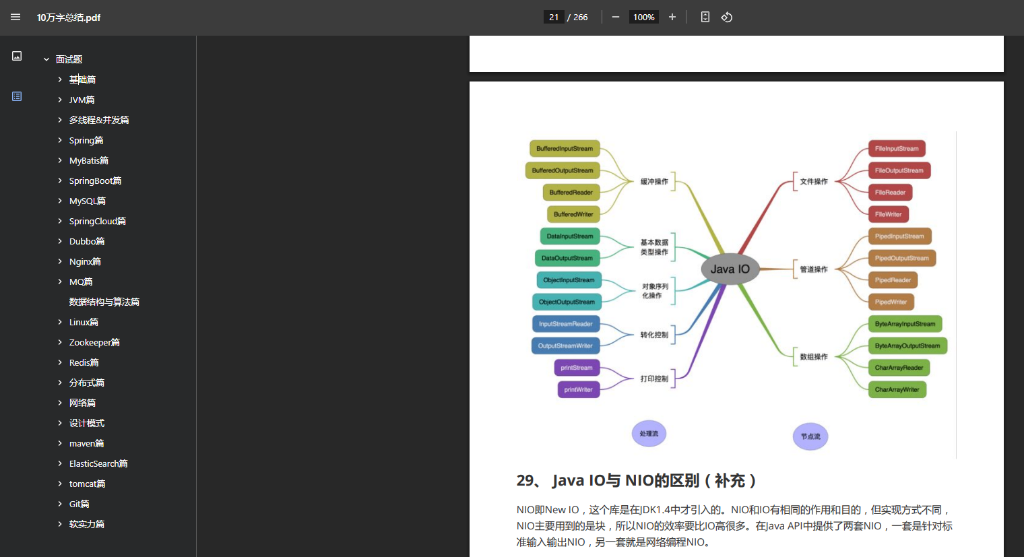

Consumer 与 Consumer Group:数据流的消费方

- Consumer Group:一组 Consumer 共同消费一个 Topic。Group 是 Kafka 实现数据流“发布-订阅”和“队列”两种模式的核心。

- Partition 分配:Group 内的 Consumer 平均分配 Topic 的 Partition。一个 Partition 同一时刻只能被 Group 内的一个 Consumer 消费。

- Offset 管理:Consumer 记录自己消费到哪个 Partition 的哪个位置(Offset)。Kafka 负责存储维护。

- 面试点:如何提高消费速度?增加 Consumer Group 内的 Consumer 数量(不能超过 Partition 总数)。

Broker 与集群:数据流的基石

- Broker:Kafka 服务节点,存储 Topic Partition 数据。

- 集群:多个 Broker 组成集群,提供高可用和负载均衡。每个 Partition 有多个副本(Replica),分布在不同 Broker。

- Leader/Follower:每个 Partition 有一个 Leader 负责读写,Follower 同步数据。Leader 挂了,Follower 接替,保证数据流持续可用。

- ISR (In-Sync Replica):与 Leader 保持同步的副本集合。只有 ISR 中的副本才有资格竞选 Leader。

(Consumer Group 协同消费 Topic 的多个 Partition)

(Consumer Group 协同消费 Topic 的多个 Partition)

Kafka 典型数据流处理场景

- 实时日志收集与分析:各服务日志 -> Kafka -> 流处理引擎 (Flink/Spark) -> 实时监控/报警。这是最经典的数据流管道。

- 事件驱动架构 (EDA):用户行为、订单状态变更等事件发布到 Kafka,下游服务订阅处理,实现松耦合。数据流驱动业务流转。

- 消息队列/削峰填谷:瞬时高峰请求写入 Kafka,后端服务按能力消费,避免被压垮。Kafka 缓冲了数据流洪峰。

- 流式ETL:源数据 -> Kafka -> 流处理清洗/转换 -> 目标库/另一个 Kafka Topic。构建实时数据流处理管道。

面试高频问题及解析思路

-

Q:Kafka 如何保证消息不丢失?

- Producer端:设置

acks=all,确保Leader和ISR副本都写入成功才返回;使用带重试机制的发送。 - Broker端:设置合理的

min.insync.replicas(e.g., >=2),保证写入成功的最小ISR数量;副本数replication.factor >=3。 - Consumer端:关闭自动提交Offset (

enable.auto.commit=false),处理完消息后手动提交Offset。避免消息没处理完就被认为已消费。

- Producer端:设置

-

Q:Kafka 如何保证消息顺序?

- 单个Partition内:消息天然有序。关键:确保需要严格顺序的数据流消息具有相同的Key,这样它们会被发到同一个Partition。

- 跨Partition:无法保证全局严格顺序。需要顺序的业务逻辑需在消费者端处理(如按Key聚合处理)。

-

Q:Kafka 为什么快?

- 顺序读写磁盘:避免磁头寻道时间。

- Page Cache:充分利用操作系统缓存。

- 零拷贝 (Zero-Copy):减少内核态到用户态的数据拷贝次数。

- 批量发送与压缩:Producer批量发,Consumer批量拉,网络IO高效;支持消息压缩。

- 分区并行:读写分散到多个Partition。

-

Q:Rebalance 是什么?触发条件?影响?

- 是什么:Consumer Group 成员变化(增、减、宕机)或订阅 Topic Partition 变化时,重新分配 Partition 给 Group 内 Consumer 的过程。

- 触发:Consumer 加入/离开 Group;订阅的 Topic Partition 数变化。

- 影响:Rebalance 期间所有 Consumer 停止消费,影响数据流处理的实时性。应避免频繁 Rebalance (合理设置

session.timeout.ms,heartbeat.interval.ms)。

-

Q:ISR 是什么?有什么用?

- 是什么:In-Sync Replicas,与 Leader 副本保持同步的副本集合。

- 作用:定义哪些副本是“健康”的。只有 ISR 中的副本才有资格被选举为新 Leader。Producer 的

acks=all要求所有 ISR 副本写入成功。它是保证数据流高可用和数据一致性的关键机制。

掌握 Apache Kafka 的核心概念和应对数据流挑战的策略,是构建现代分布式系统的必备技能。在面试中,清晰阐述其原理、权衡取舍 (如顺序 vs 并行、可靠性 vs 延迟) 和应用场景,能充分展现你的架构设计能力。

想更高效获取大厂Offer?面试鸭会员 提供海量真题详解、模拟面试与专家辅导!现在通过 面试鸭返利网 购买会员,立享 25元返利!用专业服务助你面试通关。