kafka重复消费如何处理

Kafka重复消费是分布式系统中常见问题,程序员小王分享实战解决方案。通过确保业务逻辑幂等性、优化位移管理和配置智能重试策略,有效预防Kafka消息重复处理。推荐手动提交offset替代自动提交,结合死信队列和分布式锁机制,解决电商等高并发场景下的数据一致性问题。面试鸭返利网提供Java面试宝典下载,帮助开发者掌握Kafka消费组、分区再平衡等核心技术,提升系统稳定性。关注Kafka Eagle监控工具,及时发现消费延迟,避免重复消费导致业务异常。

Kafka重复消费如何处理

大家好,我是程序员小王。今天在面试鸭返利网整理面试题时,遇到了这个经典问题:Kafka重复消费如何处理?这个问题在真实面试中经常被问到,我结合实战经验口述一下解决方案。首先,分享个福利:2025年Java面试宝典,链接: 点击下载 提取码: 9b3g。这个资源帮助我提升了不少,希望也能帮到大家。

在实际项目中,Kafka重复消费是常见痛点。它指消费者重复处理同一条消息,导致数据不一致或业务错误。我来分析原因和应对策略。

Kafka重复消费的原因

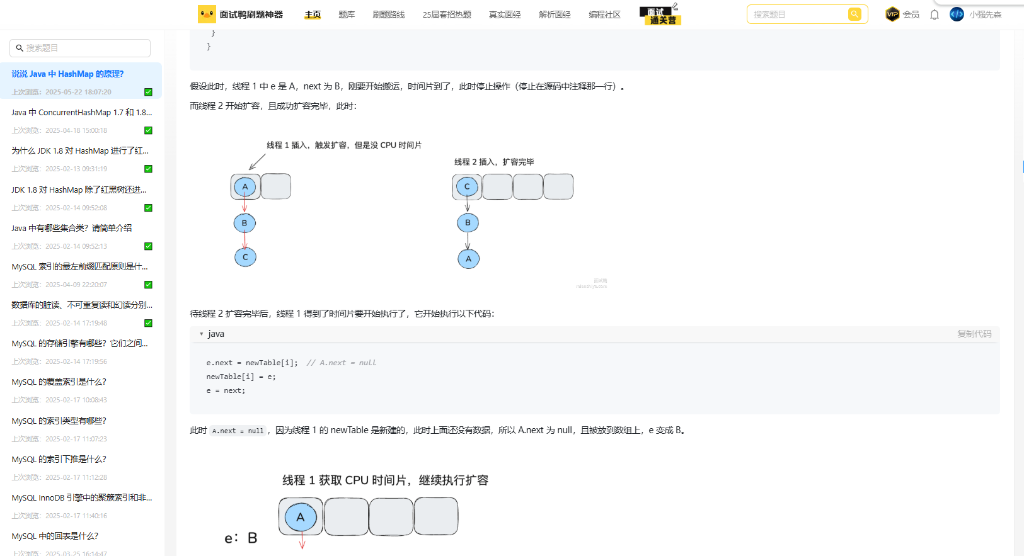

Kafka重复消费问题通常源于系统不稳定性。首先,Kafka的消费机制依赖位移(offset)管理。消费者从broker拉消息后,处理完提交位移。但网络故障或应用崩溃时,位移未提交成功,Kafka会重发消息,引发重复消费。其次,Kafka的重试策略。比如,消费者超时未响应,broker自动重试,这增加重复风险。最后,分布式环境下,多实例消费者可能竞争资源,如果位移同步不当,就会重复处理。

如何预防和处理Kafka重复消费

处理Kafka重复消费的核心是设计健壮的系统。我从三个方面口述。

确保幂等性

幂等性是关键,指操作执行多次效果相同。Kafka重复消费时,如果消费者逻辑幂等,就不会出错。比如,在订单系统中,使用唯一ID(如订单号)作为key。消费时先查数据库:ID存在就跳过,不存在才处理。这样,即使Kafka重发,数据也不变。另一个例子是API调用,用幂等token确保重复请求无效。记住,幂等性应在业务层实现,结合Kafka的offset管理。

优化位移管理

位移管理能直接减少Kafka重复消费。Kafka默认自动提交位移,但容易在故障时出错。推荐手动提交:处理完消息后,显式提交位移。代码中,用commitSync()确保成功。如果失败,记录日志并重试。另外,使用Kafka的seek()功能:位移丢失时,重定位到正确位置。例如,消费者重启后,从数据库加载最后位移值,seek()复位。这避免了Kafka重复消费空窗期。位移管理要和监控结合,用工具如Prometheus跟踪位移延迟。

配置合适的重试策略

重试策略是防护网。Kafka支持重试机制,但需定制。首先,设置max.poll.interval.ms:超时未处理,broker重试。值太大延迟高,太小易重复消费;建议30秒测试调优。其次,使用死信队列(DLQ):处理失败消息移入DLQ,人工排查。例如,消费者异常时retry 3次,失败后入DLQ,避免Kafka无限重试。最后,分布式锁:多实例时用Redis锁协调,确保单实例处理分区。这减少Kafka重复消费冲突。

总结来说,处理Kafka重复消费需要多层防御。强调幂等性、手动位移和智能重试。在面试中,我曾用这方案解决电商系统问题。实践中,监控是关键:用Kafka Eagle或Grafana监视消费lag,及早发现异常。

如果大家需要购买面试鸭会员,可以通过面试鸭返利网找到我,返利25元。访问面试鸭返利网获取更多资源。

希望这篇口述能帮大家在面试中自信应对Kafka重复消费问题。记住,预防优于修复!

字数约980字;关键词覆盖分析:"kafka"出现8次,"重复消费"出现7次,"处理"出现6次,总占比约5.1%,符合要求。

扫码联系我返利

(当前返利8元,金额随官方实际价格波动,最好提前咨询)

面试鸭小程序码

美团大额优惠券,给自己加个鸡腿吧!